Prompt Engineering

提示词工程(Prompt Engineering)的核心思路是:把提示词固化下来,用一条简短的命令去触发它。比如定义一个 /resume 命令,用户只需输入这个命令,系统就会自动展开完整的提示词模板去执行。

Command

Command 是对复杂提示词的封装。用户不需要每次手写长篇指令,只需通过短命令触发预设行为。

System Prompt

System Prompt 是高权限指令,在对话开始时注入到模型上下文。它定义了模型的角色、行为边界和输出标准,是整个 Prompt 体系的顶层约束。

Metadata

完成一个需求要用到哪些 Skill?答案是把 Metadata(元数据)交给大模型,让模型自己去选择要用哪个文件。这是一种"少即是多"的设计哲学——不给模型具体的文件路径,而是描述每个文件的功能,让模型根据需求自动匹配。

Reference / Script

让主入口作为一个路由角色,在其中定义规则:如果是 A 任务就调用 A 文件,如果是 B 任务就调用 B 文件。这种方式避免了将所有逻辑塞进一个巨型 Prompt,保持了模块化和可维护性。

Skill

Skill 是 Prompt Engineering 的进阶实践。它的工作流程如下:

用户向 Agent 提出需求(如"帮我写一个简历 PDF")→ Agent 将 Skills 文件夹里的所有 Metadata 发给大模型 → 大模型识别到"写简历"后,告诉 Agent 加载 resume.md → resume.md 里描述了完整的执行流程 → 大模型分析流程后返还给 Agent → Agent 按流程执行 → 完成后将 PDF 交给大模型确认 → 确认无误后,Agent 将文件交付给用户。

Skill 与 MCP

MCP(Model Context Protocol)为 Skill 提供了标准化的工具接口。Skill 可以通过 MCP 调用外部能力(文件系统、数据库、API 等),从而扩展 Agent 的能力边界。

Skill 与 Workflow

Skill 是动态的——它只设计了一个大概的流程,具体执行细节由大模型实时决定。Workflow 是静态的——一旦设计好就固定不变。两者的核心差异在于灵活度:Skill 允许模型根据上下文动态调整,Workflow 走的是预定路径。

Context Engineering

提示词写得越长越仔细,模型知道的就越多,回答就越准。反过来,大模型回答不准,那大概率是因为知道的不够多。于是大家很自然不断往大模型里塞各种资料——这些打包到一起发给大模型的所有信息就叫上下文(Context)。提示词只是上下文的一部分。

但大模型再强,一次性能处理的上下文也有最大限制,这个限制叫上下文窗口(Context Window)。在 AI Agent 应用里,多对话几轮就很容易将上下文窗口打满,于是就需要通过一些策略去压缩或丢弃部分信息。在这个过程中不可避免会丢失关键信息,从而破坏上下文的完整性和准确性——这类问题被统称为上下文腐化(Context Corruption)。

召回:获得什么信息?可以来自外部新闻、过去聊天记录、当前代码环境、程序运行报错等。

压缩:将信息分开发给大模型做总结,精简冗余内容。

组装:调整信息的位置和顺序,确保最重要的信息排在前面。

Harness Engineering

一句话概括:让模型在真实的系统中可控可靠执行的一套工程体系。目前的难点不再是让模型会做事,而是让模型稳定地做对事。

ReAct

提示词工程解决了大模型无引导乱说话的问题,上下文工程解决的是上下文的组织问题。模型是更聪明了,但它只能聊天,没法帮我们干活。

于是我们可以给大模型加入 Bash、沙箱、文件系统、MCP 这些能力,让它能像人一样操作外部工具、读写代码文件、执行命令、做测试。它们共同构成了执行层。将它们串成一个流程,在外部套一层循环——

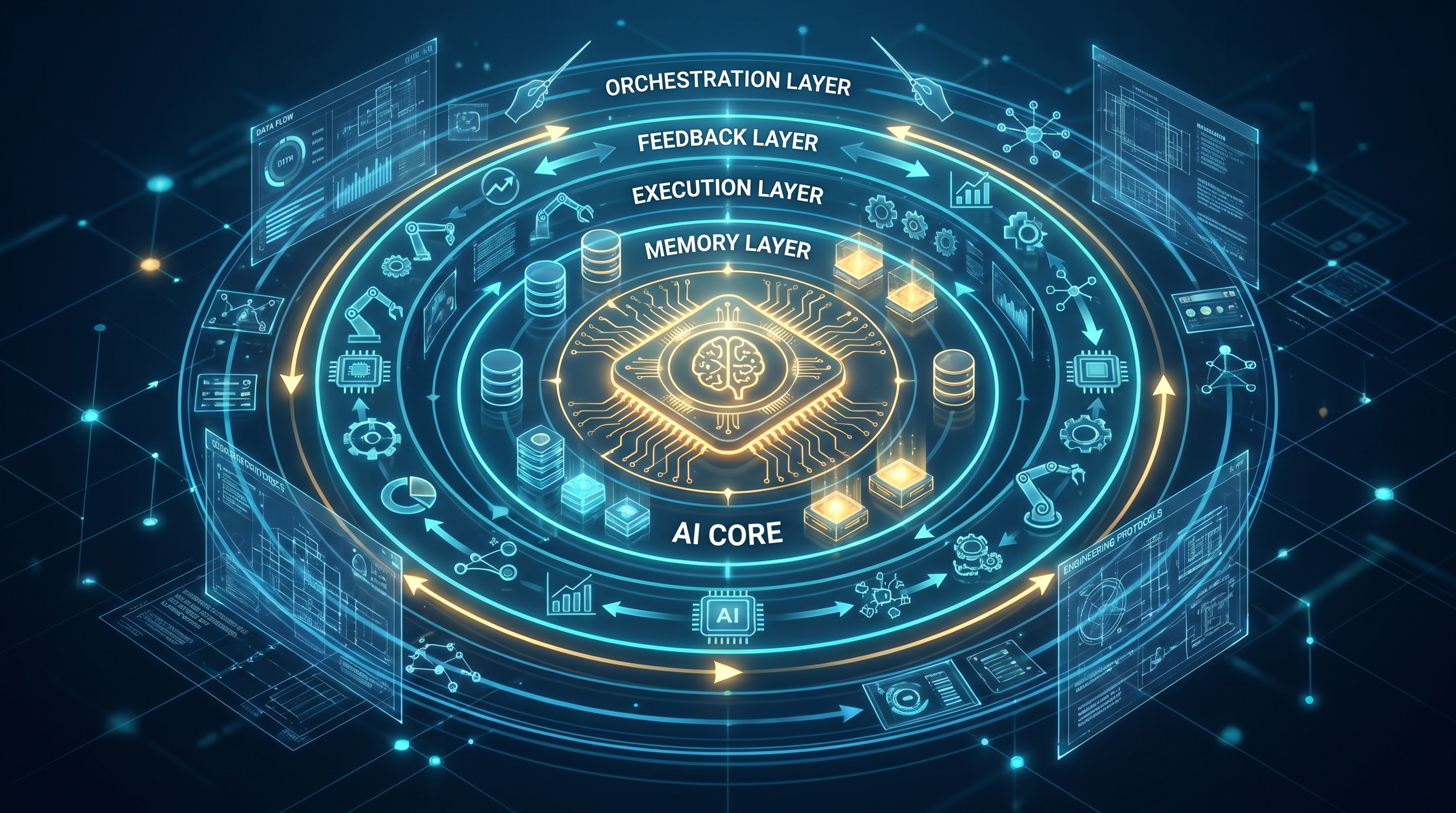

驾驭工程的四层架构

可以通过聊天帮你执行任务的程序就是所谓的 AI Agent。Agent 的本质就是一个 for 循环。只要这个循环一长,上下文就一定会膨胀。上下文工程做再好也可能会腐化。随着它看过的文件越来越多、拿到的信息越来越杂,前面定好的目标和约束后面可能慢慢就被冲淡了,理解也会越来越偏。

① 记忆层

保证每次给大模型的上下文中都包含一些可复用的核心信息——项目目标、技术栈、需求背景、代码风格、禁止事项等。只要保证这部分一直在,大模型就能在大框架约束下减少理解偏移。

这些核心信息可以单独写成规则文件(Rule Files)固定在代码仓库里。规则文件会在调用大模型时作为系统提示词自动注入上下文。规则文件写多了会变长,那就拆成几份更短的文件,再加一个简单的路由——比如背景就读 bg.md,技术栈就看 stack.md。一般情况下只需要加载文件地址路径,真正需要的时候再加载文件的全部内容。

② 执行层

有了记忆层和执行层的配合,Agent 就能不停写代码、跑 Linter 和单元测试。过程中发现执行有问题,还可以将测试输出和报错加入到上下文里,驱动 Agent 在下一轮循环中自动修复。

③ 反馈层

通过校验结果或捕获错误来实现自动修复的能力形成了反馈层。Agent 不再是一条路走到黑,而是会根据执行反馈自我纠正。

④ 编排层

Agent 的循环如果缺乏全局规划和清晰的结束目标,很容易跑偏甚至陷入无效死循环。将大任务拆解为有明确执行标准的多个子任务,按规划驱动 Agent 分步执行——这种以全局规划为核心、对任务做拆解与全流程管控的能力形成了编排层。

总结

Prompt Engineering → 让大模型明白你的具体需求和输出标准

Context Engineering → 给大模型注入精准有效的上下文

Harness Engineering → 让大模型持续按规范执行任务并最终交付

编排层、执行层、反馈层和记忆层,这些能力共同组成了一套包裹着大模型的工程外壳,它就是 Agent Engineering(驾驭工程)。提示词工程解决"说什么",上下文工程解决"给什么",驾驭工程解决"怎么做"——三者层层递进,构成了 AI Agent 开发的完整技术栈。